Home / Nosso Blog

Leve seu marketing digital para o próximo nível com estratégias baseadas em dados e soluções inovadoras. Vamos criar algo incrível juntos!

Acompanhe semanalmente nosso canal no youtube com vídeos de marketing e performance e se inscreva-se

Na última década, o SEO de imagens foi em grande parte uma questão de higiene técnica:

Embora estas práticas continuem a ser fundamentais para um site saudável, o surgimento de grandes modelos multimodais, como ChatGPT e Gemini, introduziu novas possibilidades e desafios.

A pesquisa multimodal incorpora tipos de conteúdo em um espaço vetorial compartilhado.

Agora estamos otimizando para o “olhar da máquina”.

A pesquisa generativa torna a maior parte do conteúdo legível por máquina, segmentando a mídia em pedaços e extraindo texto de recursos visuais por meio do reconhecimento óptico de caracteres (OCR).

As imagens devem ser legíveis ao olho da máquina.

Se uma IA não consegue analisar o texto na embalagem do produto devido ao baixo contraste ou alucina detalhes devido à baixa resolução, isso é um problema sério.

Este artigo desconstrói o olhar da máquina, mudando o foco da velocidade de carregamento para a legibilidade da máquina.

Antes de otimizar a compreensão da máquina, devemos respeitar o guardião: o desempenho.

As imagens são uma faca de dois gumes.

Eles impulsionam o engajamento, mas geralmente são a principal causa da instabilidade do layout e da lentidão.

O padrão “bom o suficiente” foi além do WebP.

Assim que o ativo for carregado, o verdadeiro trabalho começa.

Aprofunde-se: como a descoberta multimodal está redefinindo o SEO na era da IA

Para grandes modelos de linguagem (LLMs), imagens, áudio e vídeo são fontes de dados estruturados.

Eles usam um processo chamado tokenização visual para quebrar uma imagem em uma grade de patches, ou tokens visuais, convertendo pixels brutos em uma sequência de vetores.

Essa modelagem unificada permite que a IA processe “uma imagem de um (token de imagem) em uma mesa” como uma única frase coerente.

Esses sistemas contam com OCR para extrair texto diretamente de recursos visuais.

É aqui que a qualidade se torna um fator de classificação.

Se uma imagem for fortemente compactada com artefatos com perdas, os tokens visuais resultantes ficarão barulhentos.

A má resolução pode fazer com que o modelo interprete mal esses tokens, levando a alucinações nas quais a IA descreve com segurança objetos ou textos que na verdade não existem porque as “palavras visuais” não eram claras.

Para modelos de linguagem grandes, o texto alternativo tem uma nova função: fundamentação.

Ele atua como uma sinalização semântica que força o modelo a resolver tokens visuais ambíguos, ajudando a confirmar a interpretação de uma imagem.

Como Zhang, Zhu e Tambe observado:

Dica: Ao descrever os aspectos físicos da imagem – a iluminação, o layout e o texto no objeto – você fornece dados de treinamento de alta qualidade que ajudam o olho da máquina a correlacionar tokens visuais com tokens de texto.

Agentes de pesquisa como Google Lens e Gemini usam OCR para ler ingredientes, instruções e recursos diretamente das imagens.

Eles podem então responder a perguntas complexas dos usuários.

Como resultado, o SEO de imagens agora se estende às embalagens físicas.

Regulamentações atuais de rotulagem – FDA 21 CFR 101.2 e UE 1169/2011 – permitem tamanhos de tipo tão pequenos quanto 4,5 pt a 6 pt, ou 0,9 mm, em embalagens compactas.

Embora isso satisfaça o olho humano, falha no olhar da máquina.

O resolução mínima de pixels exigido para texto legível por OCR é muito maior.

A altura dos caracteres deve ser de pelo menos 30 pixels.

Baixo contraste também é um problema. O contraste deve atingir 40 valores em tons de cinza.

Tenha cuidado com fontes estilizadas, que podem fazer com que os sistemas de OCR confundam um “l” minúsculo com um “1” ou um “b” com um “8”.

Além do contraste, acabamentos reflexivos criar problemas adicionais.

As embalagens brilhantes refletem a luz, produzindo brilho que obscurece o texto.

A embalagem deve ser tratada como um recurso de legibilidade mecânica.

Se uma IA não conseguir analisar uma foto de embalagem por causa do brilho ou de uma fonte de script, ela poderá alucinar informações ou, pior, omitir totalmente o produto.

A originalidade pode parecer um traço criativo subjetivo, mas pode ser quantificada como um dado mensurável.

As imagens originais atuam como um sinal canônico.

A API Google Cloud Vision inclui um recurso chamado Detecção de Webque retorna listas de fullMatchingImages – duplicatas exatas encontradas na web – e pagesWithMatchingImages.

Se o seu URL tiver a data de indexação mais antiga para um conjunto exclusivo de tokens visuais (ou seja, um ângulo específico do produto), o Google credita a sua página como a origem dessa informação visual, aumentando sua pontuação de “experiência”.

Aprofunde-se: Conteúdo visual e SEO: como usar imagens e vídeos

Obtenha o boletim informativo em que os profissionais de marketing de busca confiam.

A IA identifica cada objeto em uma imagem e usa seus relacionamentos para inferir atributos sobre uma marca, faixa de preço e público-alvo.

Isso torna a adjacência do produto um sinal de classificação. Para avaliá-lo, você precisa auditar suas entidades visuais.

Você pode testar isso usando ferramentas como a API Google Vision.

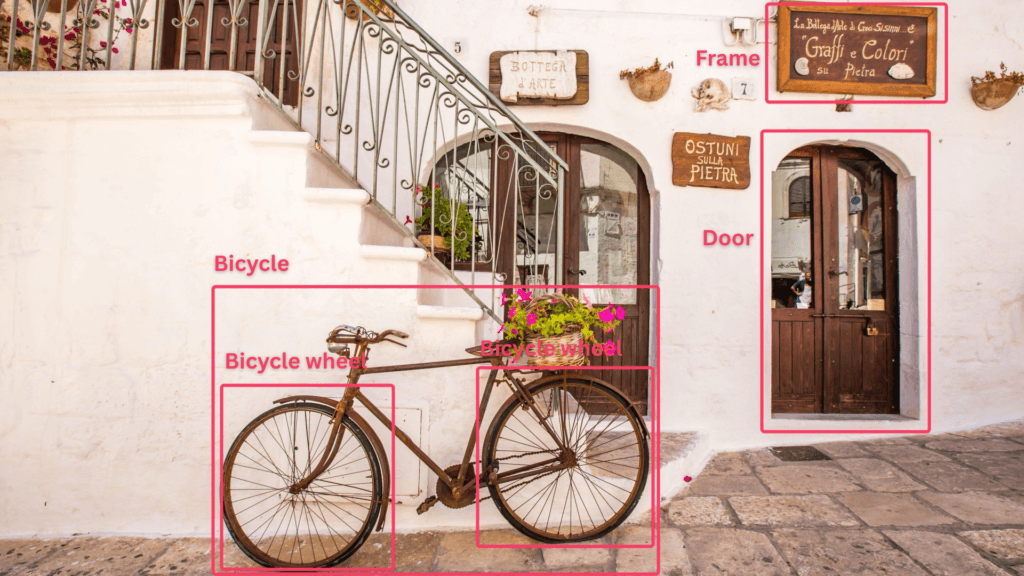

Para uma auditoria sistemática de uma biblioteca de mídia inteira, você precisa extrair o JSON bruto usando o OBJECT_LOCALIZATION recurso.

A API retorna rótulos de objetos como “relógio”, “saco plástico” e “copo descartável”.

O Google fornece este exemploonde a API retorna as seguintes informações para os objetos na imagem:

| Nome | meio | Pontuação | Limites |

| Roda de bicicleta | /m/01bqk0 | 0,89648587 | (0,32076266, 0,78941387), (0,43812272, 0,78941387), (0,43812272, 0,97331065), (0,32076266, 0,97331065) |

| Bicicleta | /m/0199g | 0,886761 | (0,312, 0,6616471), (0,638353, 0,6616471), (0,638353, 0,9705882), (0,312, 0,9705882) |

| Roda de bicicleta | /m/01bqk0 | 0,6345275 | (0,5125398, 0,760708), (0,6256646, 0,760708), (0,6256646, 0,94601655), (0,5125398, 0,94601655) |

Bom saber: meio contém um identificador gerado por máquina (MID) correspondente ao rótulo de uma etiqueta Gráfico de conhecimento do Google entrada.

A API não sabe se este contexto é bom ou ruim.

Você faz isso, então verifique se os vizinhos visuais estão contando a mesma história que sua etiqueta de preço.

Ao fotografar um relógio de couro azul ao lado de uma bússola de latão vintage e uma superfície quente de madeira, Lord Leathercraft cria um sinal semântico específico: exploração do patrimônio.

A co-ocorrência de mecânica analógica, metal envelhecido e camurça tátil infere uma personalidade de aventura atemporal e sofisticação do velho mundo.

Fotografe o mesmo relógio ao lado de uma bebida energética neon e de um cronômetro digital de plástico e a narrativa muda através da dissonância.

O contexto visual agora sinaliza utilidade para o mercado de massa, diluindo o valor percebido da entidade.

Aprofunde-se: como tornar os produtos legíveis por máquina para pesquisa multimodal de IA

Além dos objetos, esses modelos são cada vez mais adeptos da leitura de sentimentos.

APIs, como o Google Cloud Vision, podem quantificar atributos emocionais atribuindo pontuações de confiança a emoções como “alegria”, “tristeza” e “surpresa” detectadas em rostos humanos.

Isso cria um novo vetor de otimização: o alinhamento emocional.

Se você está vendendo roupas divertidas de verão, mas os modelos parecem temperamentais ou neutros – um tropo comum na fotografia de alta moda – a IA pode despriorizar a imagem para essa consulta porque o sentimento visual entra em conflito com a intenção de pesquisa.

Para uma verificação rápida sem escrever código, use Demonstração ao vivo de arrastar e soltar do Google Cloud Vision para revisar as quatro emoções primárias: alegria, tristeza, raiva e surpresa.

Para intenções positivas, como “jantar feliz em família”, você deseja que o atributo alegria seja registrado como VERY_LIKELY.

Se lê POSSIBLE ou UNLIKELYo sinal é muito fraco para que a máquina indexe com segurança a imagem como feliz.

Para uma auditoria mais rigorosa:

A API retorna esses valores como enumerações ou categorias fixas.

Este exemplo vem diretamente do documentação oficial:

"rollAngle": 1.5912293,

"panAngle": -22.01964,

"tiltAngle": -1.4997566,

"detectionConfidence": 0.9310801,

"landmarkingConfidence": 0.5775582,

"joyLikelihood": "VERY_LIKELY",

"sorrowLikelihood": "VERY_UNLIKELY",

"angerLikelihood": "VERY_UNLIKELY",

"surpriseLikelihood": "VERY_UNLIKELY",

"underExposedLikelihood": "VERY_UNLIKELY",

"blurredLikelihood": "VERY_UNLIKELY",

"headwearLikelihood": "POSSIBLE"

A API classifica a emoção em uma escala fixa.

O objetivo é mover imagens primárias de POSSIBLE para LIKELY ou VERY_LIKELY para a emoção alvo.

UNKNOWN (lacuna de dados).VERY_UNLIKELY (forte sinal negativo).UNLIKELY.POSSIBLE (neutro ou ambíguo).LIKELY.VERY_LIKELY (forte sinal positivo – direcione isso).Você não pode otimizar a ressonância emocional se a máquina mal consegue ver o humano.

Se detectionConfidence estiver abaixo de 0,60, a IA está lutando para identificar um rosto.

Como resultado, qualquer leitura de emoção ligada a esse rosto é um ruído estatisticamente não confiável.

Embora a documentação do Google não forneça essa orientação e a Microsoft ofereça acesso limitado ao seu serviço Azure AI FaceDocumentação do Amazon Rekognition observa que:

Trate os recursos visuais com o mesmo rigor editorial e intenção estratégica do conteúdo principal.

A lacuna semântica entre imagem e texto está desaparecendo.

As imagens são processadas como parte da sequência de linguagem.

A qualidade, clareza e precisão semântica dos próprios pixels agora são tão importantes quanto as palavras-chave na página.

Os autores colaboradores são convidados a criar conteúdo para o Search Engine Land e são escolhidos por sua experiência e contribuição para a comunidade de pesquisa. Nossos colaboradores trabalham sob a supervisão da equipe editorial e as contribuições são verificadas quanto à qualidade e relevância para nossos leitores. Search Engine Land é propriedade de Semrush. O Colaborador não foi solicitado a fazer qualquer menção direta ou indireta de Semrush. As opiniões que expressam são próprias.

Myriam Jessier

”Negócio desatualizado ele não está apenas perdendo dinheiro, mas está perdendo a chance de fazer a diferença ao mundo”

Produtor

Fale agora com um especialista da Atualizex e receba uma análise estratégica personalizada para o seu negócio.

Falar com Especialista no WhatsApp